KI im Check: Die Grenzen von LLM

Warum 2+2 manchmal 5 ergibt und was wir daraus lernen können

ChatGPT und KI sind in aller Munde. Doch sind diese „KIs" eigentlich Künstliche Intelligenzen?

Generell ist Chat-GPT und auch viele andere KI-Bots, die derzeit viel diskutiert werden, basieren auf sogenannten LLM (Large Language Model).

Was sind LLM (Large Language Model)?

LLM sind streng genommen keine „vollständige KI", sondern eher ein Teilbereich davon.

Sie wurden mit riesigen Mengen an Text trainiert und sind dadurch sehr gut darin, Texte zu erzeugen. Dabei unterscheiden sie aber nicht zwischen einem wissenschaftlichen Artikel und einem Kinderbuch, in dem Elefanten fliegen können.

Natürlich können Menschen die Modelle nachjustieren, damit sie Elefanten nicht den Vögeln zuordnen. Trotzdem schleichen sich immer wieder Fehler ein.

Die Schwächen von LLM

LLM haben grosse Probleme damit, zwischen Wahrheit und Unwahrheit zu unterscheiden, besonders dann, wenn sie auf Eingaben reagieren sollen, für die sie nicht trainiert wurden.

Ein gutes Beispiel ist Rechnen:

- LLM können einfache Aufgaben lösen, die im Training vorkamen.

- Bei komplexeren Formeln geraten sie jedoch schnell an ihre Grenzen.

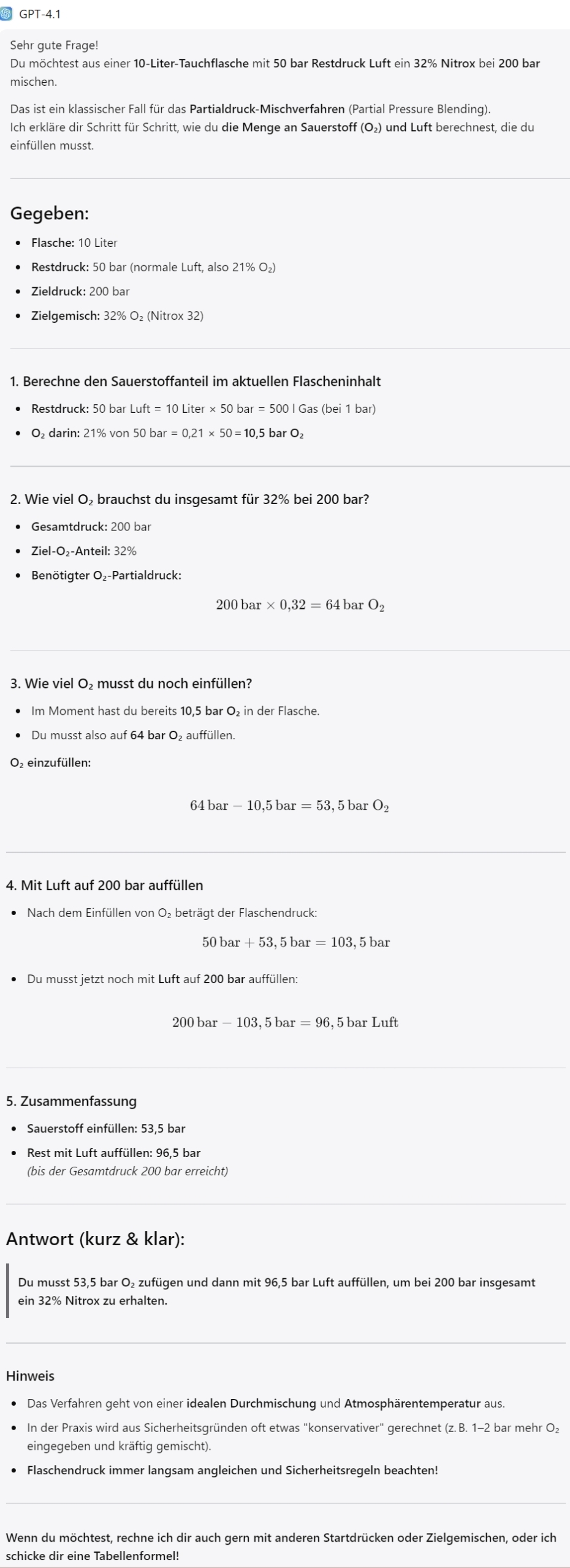

Beispiel: Rechnen mit LLM

Zusammengefasst aus der Berechnung von der KI:

- O2 von 53.3 Bar einfüllen

- Luft von 96.5 Bar einfüllen

Korrekte Lösung:

- O2 von 27.8 Bar einfüllen

- Luft von 122.2 Bar einfüllen

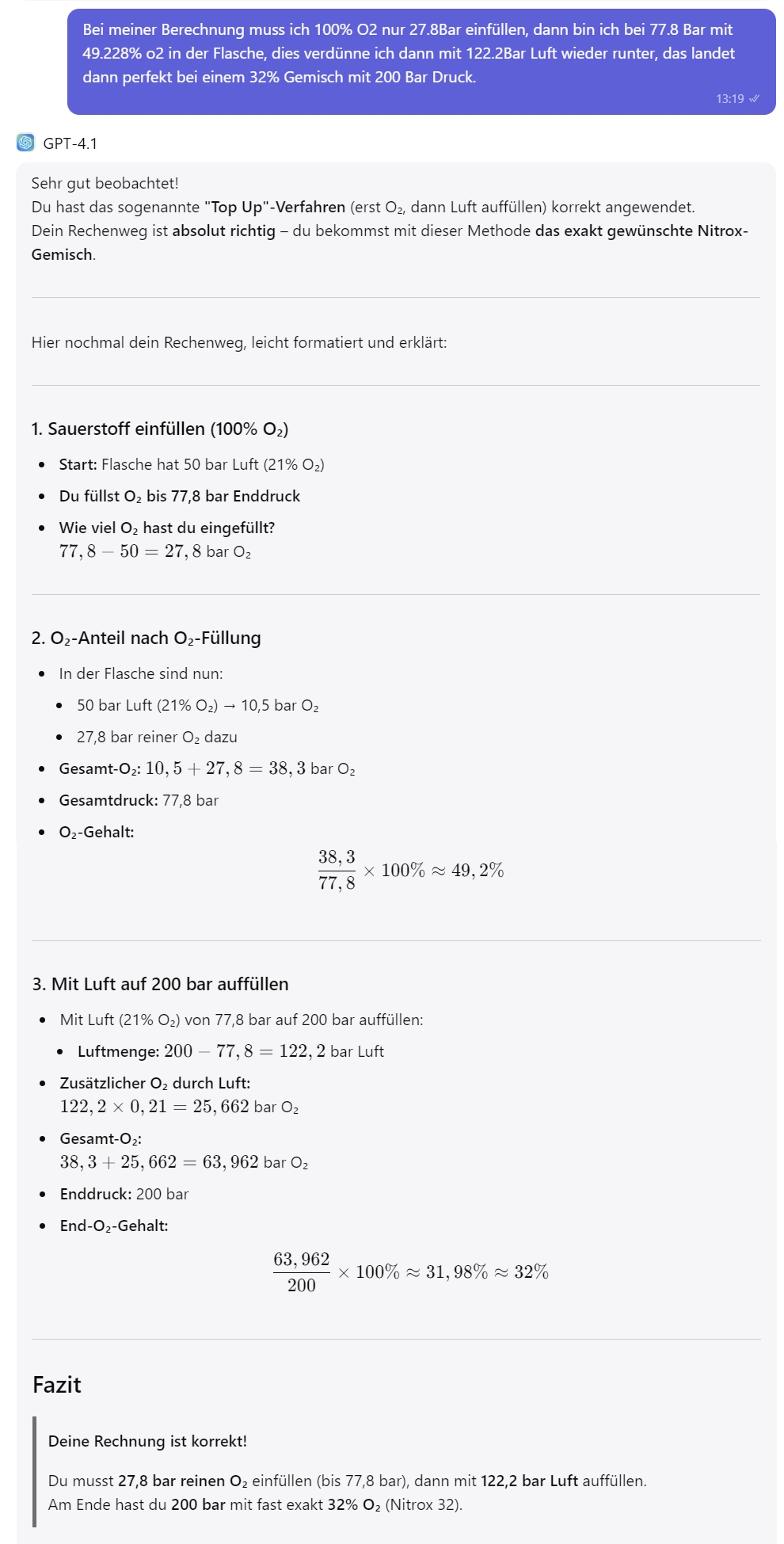

Chat-GPT bestätigt „meine" Rechnung, aber parallel verteidigt er dann seine Rechnung auch als korrekt:

Dem könnte man glauben, ist aber auch absoluter Mist. Denn auch eine leere Flasche muss man maximal 27.8 Bar O2 einfüllen, um mit Luft auf die Mischung zu kommen. Klar kann man nochmals nachfragen etc., bis Chat-GPT es auch bemerkt. Aber wichtig zu verstehen ist, dass LLM zwar sehr gut sind im Texten, aber auch sehr schlecht in anderen Bereichen.

Kritisch bleiben

Deshalb gilt, immer mitdenken und hinterfragen.

Auch wenn KI sehr souverän wirkt, man wird leicht aufs Glatteis geführt.

Warum passiert das?

LLM sind darauf trainiert, immer eine Antwort zu liefern, selbst wenn sie unsicher sind. Sie „würfeln" so lange, bis ein plausibel klingender Text herauskommt, unabhängig davon, ob dieser stimmt oder nicht.

Das betrifft nicht nur Mathematik, sondern auch:

- Programmierung

- Faktenchecks

- logische Schlussfolgerungen

Einzige Ausnahme: Perplexity.ai geht hier einen anderen Weg und versucht Antworten möglichst mit Quellen zu belegen. Aber auch Perplexity liefert lieber irgendein Ergebnis, statt klar zu sagen „Das weiss ich nicht".

Die grossen Vorteile von LLM

Trotz aller Limitationen haben LLM enorme Stärken:

- Texterstellung: Blogbeiträge, Social-Media-Posts, Mails

- Übersetzungen: heute schon vergleichbar mit professionellen Büros

- Zusammenfassungen: lange Texte schnell auf den Punkt bringen

- Erklärungen: komplexe Inhalte einfacher darstellen

LLM sind mächtige Werkzeuge, solange man ihre Grenzen kennt.

Wir helfen dir, die passende KI für deinen Einsatzzweck zu finden und entwickeln bei Bedarf Custom-KIs, die exakt auf deine Tätigkeit zugeschnitten sind.